LLM知识库 | Karpathy

作者:Karpathy | 日期:2026年4月3日

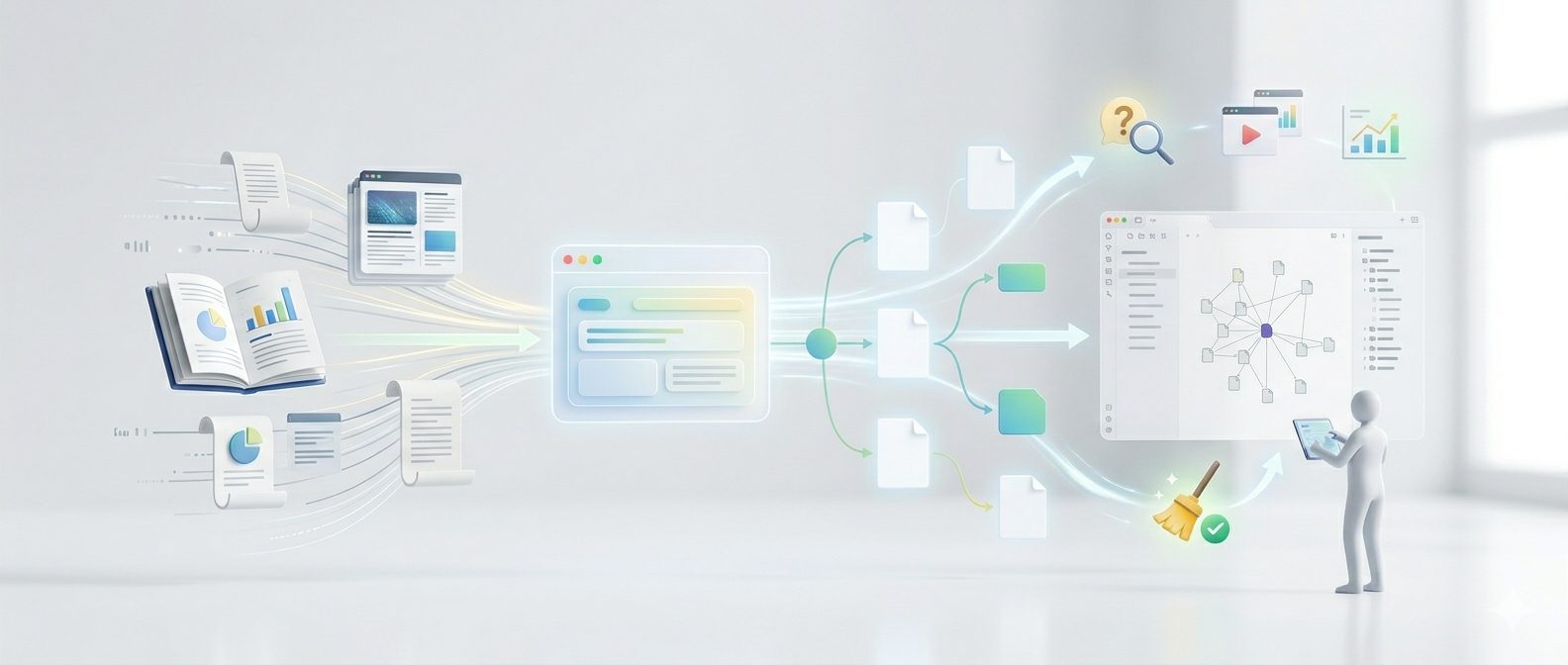

我最近发现一件非常有用的事:用 LLM 为各种自己感兴趣的研究主题构建个人知识库。这样一来,我最近相当大一部分 token 吞吐不再花在操作代码上,而是更多花在操作知识上,这些知识以 Markdown 和图片的形式存储。最新的 LLM 在这件事上已经相当擅长。所以:

数据摄取

我会把源文档,例如文章、论文、代码仓库、数据集、图片等,索引到 raw/ 目录里,然后用 LLM 逐步“编译”出一个 wiki,本质上就是按目录结构组织的一组 .md 文件。这个 wiki 包含 raw/ 中所有数据的摘要、反向链接,然后再把数据归类到不同概念下,为这些概念撰写文章,并把它们彼此链接起来。把网页文章转成 .md 文件时,我喜欢用 Obsidian Web Clipper 扩展;同时我也会用一个快捷键把相关图片全部下载到本地,这样我的 LLM 就能很方便地引用它们。

IDE

我把 Obsidian 当作 IDE 的“前端”,在里面查看原始数据、编译后的 wiki,以及派生出来的可视化结果。需要注意的是,wiki 的全部数据都是由 LLM 来编写和维护的,我很少直接去改它。我也尝试过一些 Obsidian 插件,用其他方式渲染和查看这些数据,例如用 Marp 做幻灯片。

问答

真正开始变得有意思的地方在于,一旦你的 wiki 足够大,例如我针对某些最近研究整理出的 wiki 已经有大约 100 篇文章、约 40 万词,你就可以让自己的 LLM agent 围绕这个 wiki 回答各种复杂问题,它会自己去研究答案等等。我原本以为自己得上复杂的 RAG,但在这种较小规模下,LLM 已经很擅长自动维护索引文件、生成所有文档的简要摘要,并且相当容易地读入所有重要的相关数据。

输出

我不太喜欢直接得到文本或终端里的答案,我更喜欢让它为我渲染出 Markdown 文件、幻灯片(Marp 格式)或者 matplotlib 图片,然后我再回到 Obsidian 里查看。根据查询内容的不同,你还能想象很多别的可视化输出形式。很多时候,我最终会把这些输出重新“归档”回 wiki,用来增强后续查询的效果。所以我自己的探索和提问会不断沉淀进知识库。

清理与校验

我会在这个 wiki 上跑一些 LLM “健康检查”,例如找出不一致的数据、借助网页搜索补全缺失数据、找出值得写成新文章的有趣联系等等,以便逐步清理 wiki 并提升整体数据完整性。LLM 也很擅长提出更多值得继续追问和研究的问题。

额外工具

我发现自己也在开发更多处理这些数据的工具。比如我随手写了一个基于这个 wiki 的小型、朴素搜索引擎,我既会直接在 Web UI 里使用它,但更多时候是希望把它通过 CLI 交给 LLM,作为处理更大规模查询的一个工具。

进一步探索

随着这个仓库不断增长,一个自然会出现的想法是进一步考虑合成数据生成和微调,让你的 LLM 不只是通过上下文窗口理解这些数据,而是把这些数据“学进”模型权重里。

TLDR

系统会先收集若干来源的原始数据,再由 LLM 将其编译成一个 .md 形式的 wiki,然后 LLM 再通过各种 CLI 围绕它做问答并持续增强这个 wiki,所有内容都可以在 Obsidian 中查看。你几乎不需要手动编写或编辑这个 wiki,这基本就是 LLM 的工作范围。我觉得这里完全有机会做出一款非常棒的新产品,而不只是一些临时拼出来的脚本集合。

https://x.com/karpathy/status/2039805659525644595

如果觉得内容不错,欢迎你点一下「在看」,或是将文章分享给其他有需要的人^^

相关好文推荐:

一种快速判别产品AI含量的黄金指标,帮你远离披着AI外皮的传统软件公司

0条留言