Yann LeCun 团队新作:让机器拥有物理常识的极简路径

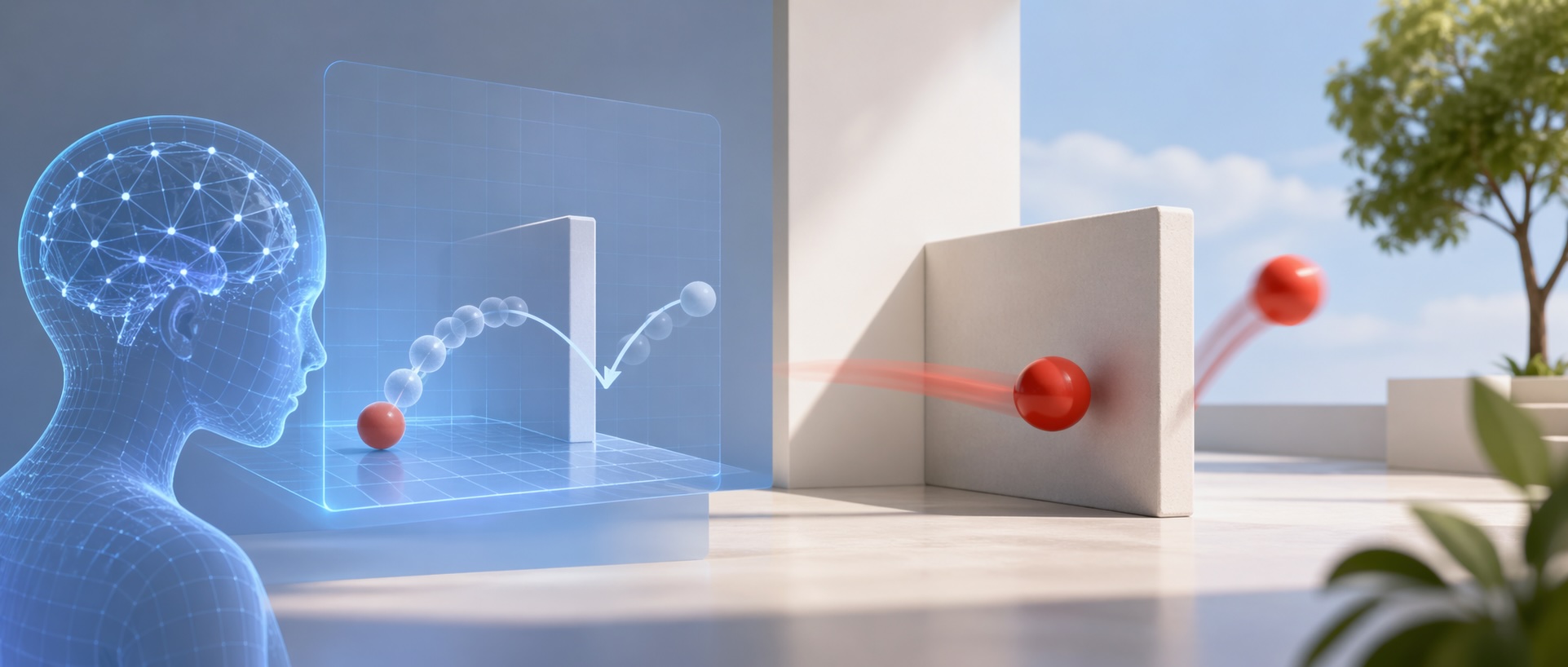

如果你让现在的 AI 画一个“球撞墙后弹回”的视频,它可能画得美轮美奂,但也可能让球直接穿墙而过。这种“物理常识的缺失”是当前生成式 AI 的阿克琉斯之踵。近日,图灵奖得主 Yann LeCun 团队发布了重磅论文 LeWorldModel (LeWM),它用极其优雅的方式,解决了 AI “看懂”世界的难题。

在人工智能的圈子里,一直存在两种派系的争论:

一种认为,只要数据足够多,AI 靠“背诵”像素就能学会一切(比如现在的 Sora);

另一种则认为,AI 必须像人类一样,在脑子里建立一个 “世界模型”,理解物体、力和因果。

Yann LeCun 显然是后者的旗手。他最新参与的这篇论文,不仅证明了“物理常识”可以学出来,还证明了:理解世界,其实不需要庞大的算力。

痛点:为什么 AI 总是“物理性弱智”?

现在的视频生成模型(如 Sora)更像是一个追求视觉效果的画师。它预测下一帧时,会试图精细到每一颗尘埃的摆动。

但这带来两个问题:

-

• 太累了: 算力全浪费在不重要的背景细节上。 -

• 没脑子: 它只知道像素点应该怎么排,不知道“球不能穿墙”。

LeCun 倡导的 JEPA(联合嵌入预测架构) 则完全不同。它不画图,它只在脑子里生成 “特征”(Embedding)。就像你走路时,脑子里不会渲染出每一片叶子的形状,你只关注路在哪里。

突破:如何治好 AI 的“偷懒症”?

以前训练这种“脑内模拟器”非常痛苦,AI 极易进入一种 “表示坍缩(Collapse)” 的状态。

什么是坍缩? 想象一个极度厌学的学生,无论老师问什么,他都回答“我不知道”。因为这样回答最省力,且逻辑上“稳定”。AI 也是,它会倾向于把所有复杂的图像都映射成同一个简单的数值,导致模型彻底失效。

为了治这个“病”,以前科学家得给 AI 加上各种复杂的“支架”(如 EMA、预训练编码器等),就像给一个学步的孩子安了一圈护栏,非常臃肿。

LeWM 的神来之笔:

作者发明了一个叫 SIGReg 的“隐形围栏”。它不需要复杂的技巧,只是通过数学手段强制要求:AI 脑子里的思维分布必须像一个均匀的球体(高斯分布)。

这一招直接让模型摆脱了“支架”,超参数从 6 个减到了 1 个,训练稳如老狗。

结果:小模型,大智慧

这篇论文最让业界震惊的是它的效率数据:

-

• 极简参数: 只有 1500 万(15M) 参数。相比于动辄千亿参数的大模型,它简直像一只灵活的猴子。 -

• 速度惊人: 在规划路径和预测未来时,它比基于大模型的方法快了 48 倍。 -

• 自悟物理: 研究者发现,没人告诉 AI 什么是速度、质量、角度,但 AI 在观察视频的过程中,自动在脑子里对应上了这些物理量。

最有趣的一个实验是:当视频中出现“球穿墙”这种违背常识的画面时,AI 会表现出明显的“惊奇”(损失函数剧增)。这意味着,它真的看懂了规则。

为什么这对我们很重要?

如果你是一个技术架构师,或者关注机器人、自动驾驶的开发者,这篇文章释放了一个强烈的信号:AI 的重心正在从“语言模型”转向“世界模型”。

-

• 机器人时代的入场券: 机器人进厨房拿杯子,不需要实时渲染 4K 画面,它只需要一个像 LeWM 这样轻量、快速、理解物理规律的“脑中小地图”。 -

• 算力平权: 这种模型在单张显卡上几个小时就能练成,这意味着未来“物理常识”将不再是大厂的垄断资产。

结语

LeCun 一直在强调:“世界不是由文本组成的,而是由物体和法则组成的。”

LeWorldModel 的出现,标志着我们离那种“像孩子一样通过观察就能学会世界运行逻辑”的 AI 又近了一步。它不再是一个只会预测概率的复读机,而是一个正在睁眼看世界的观察者。

https://le-wm.github.io/

如果觉得内容不错,欢迎你点一下「在看」,或是将文章分享给其他有需要的人^^

相关好文推荐:

一种快速判别产品AI含量的黄金指标,帮你远离披着AI外皮的传统软件公司

0条留言